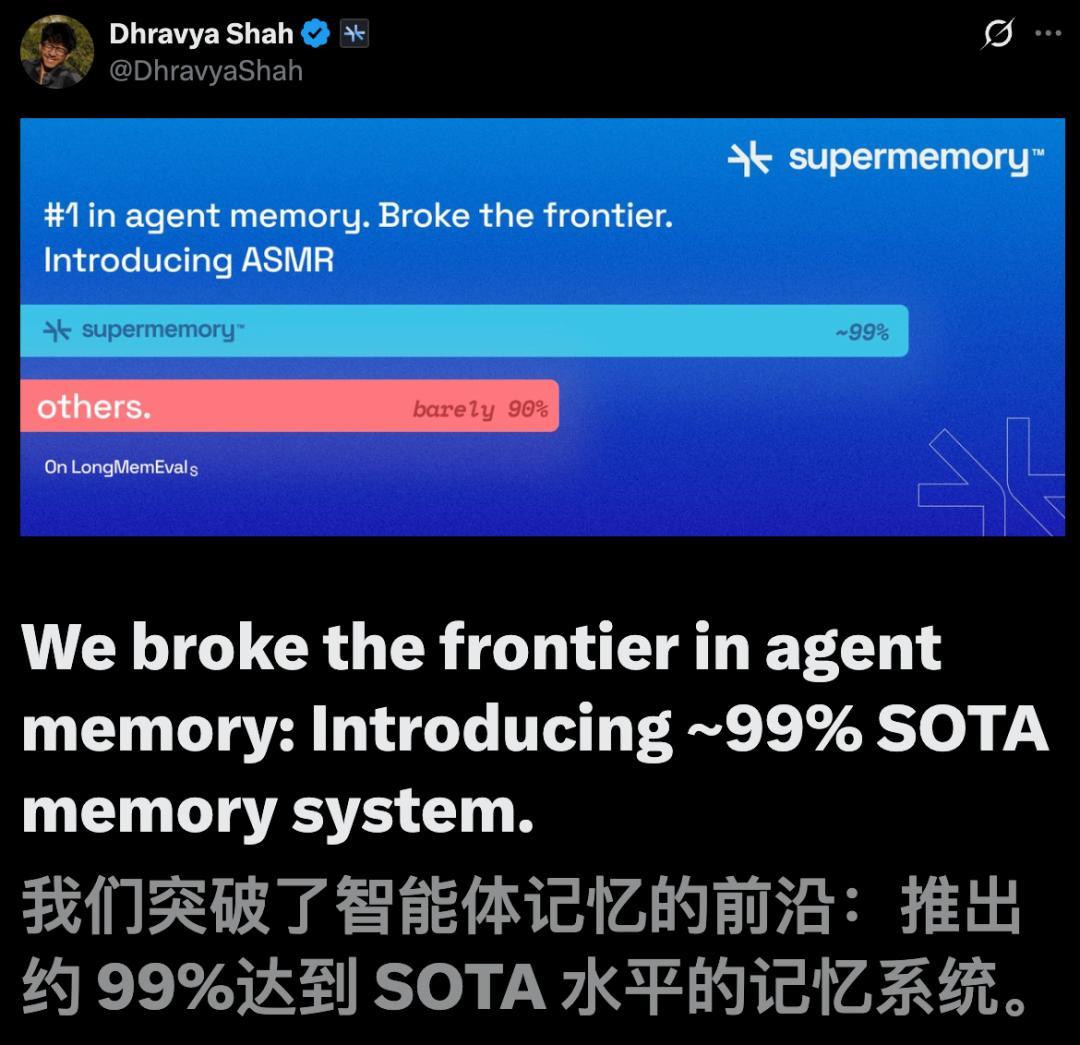

AI终于有了「长久挂念」!今天,超等挂念系统ASMR重磅登场,在业界公认最难AI挂念熏陶中,刷爆SOTA拿下99%收货。全网直呼太纵脱。

AI挂念难题,已透彻被解决?

今天,一个Supermemory团队爆火出圈,向全寰球扔出了一颗核弹——

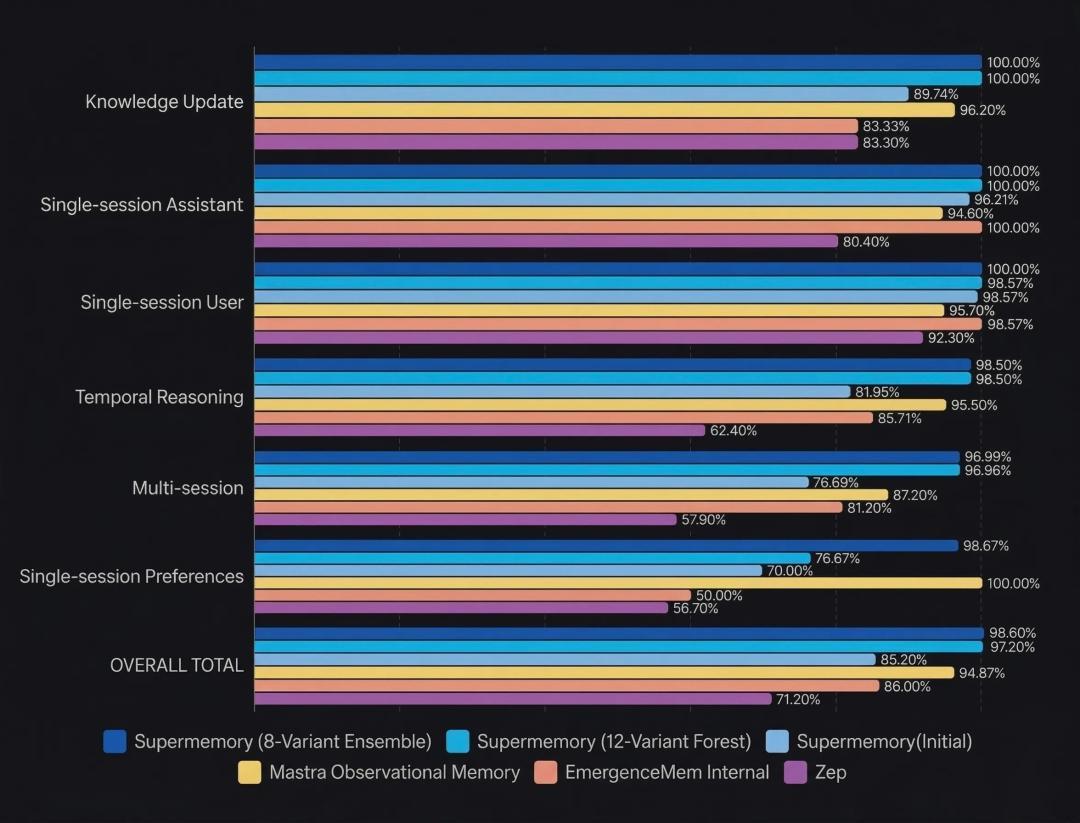

超等挂念系统「ASMR」问世,把AI挂念界最难熏陶LongMemEval,刷到了99%准确率。

环球数十亿Agent皆需要挂念,而如今,AI「忘记症」简直被攻克了。

是的,你莫得听错!

ASMR以近乎无敌的姿态刷爆SOTA,一期间登上了今天X的热榜。

它撤销了传统的「向量数据库」,撤销了镶嵌(embedding)方法,十足在内存中运行。

这一次,ASMR全程选拔「多Agent并行推理」的活水线,具体单干如下:

3个「不雅察者Agent」并行读取原始数据,索求个东谈主信息、偏好、期间线等六大维度信息;

当用户发问时,再派出3个「搜索Agent」进行主动推理检索。

如今,全网被「太纵脱了」刷屏了。

值得一提的是,ASMR将于4月初开源通盘代码,AI挂念的「大帆海时期」讲求开启!

今夜之间,AI有了「长久挂念」

源头,如故要mark下这篇博客第一句话——

AI Agent的挂念问题刻下可能照旧十足解决了。

几个月前,Supermemory祭出首份商酌表现注解,便在LongMemEval-s测试中拿下了85%的收货。

这一分数,早就最初于那时系数公开的挂念系统。

而今天,超等挂念系统「ASMR」(智能体搜索与挂念检索)的出世,再一次刷新了记录。

它的本事罢了,相等节略。

不需要向量数据库、镶嵌(embeddings),径直十足在内存中运行。

这意味着,它不错被内嵌到其他系统中,以致是机器东谈主等硬件中。

那么,ASMR具体是怎么被打造出来的?

ASMR:多Agent并行干活

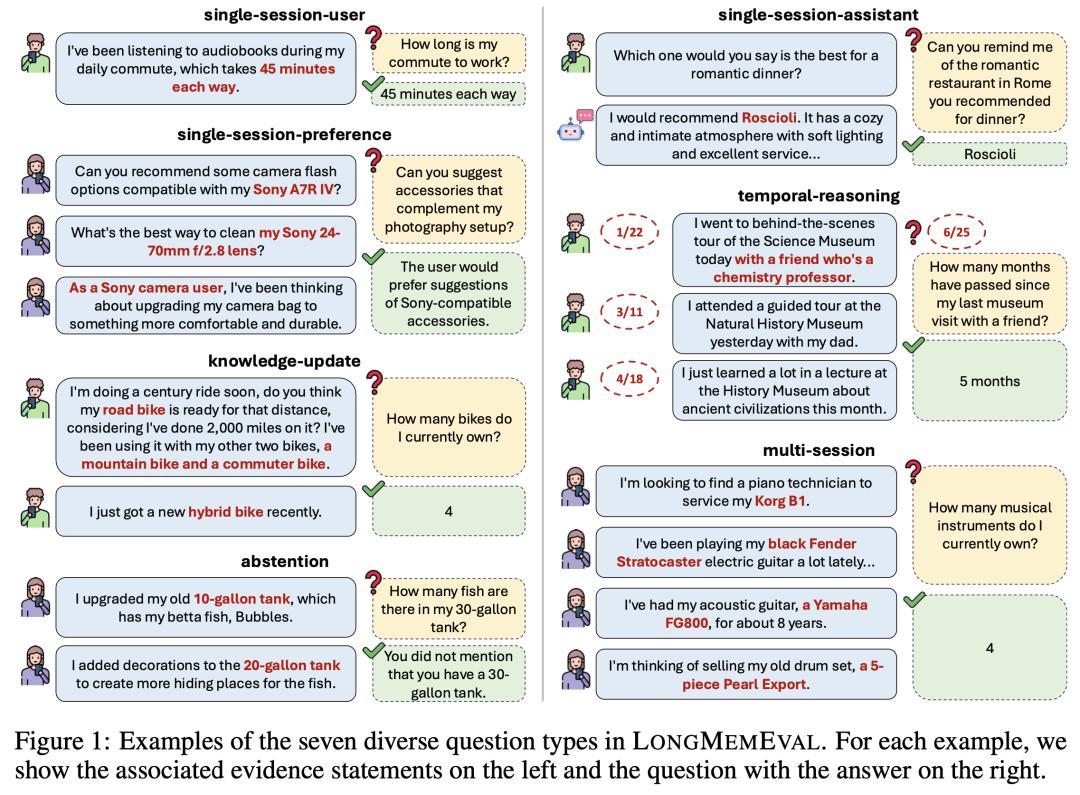

要知谈,LongMemEval是刻下公开可见的、最严苛的恒久挂念基准测试之一。

好多基准测试只考量短高下文中的节略检索,但LongMemEval不同,它旨在模拟的确出产环境中的各式狼籍词语情况:

在超11.5万智元(Token)的对话历史、互相矛盾的信息、进步多个会话的零碎事件,还需进行期间推理的复杂问题。

大多数挂念系统发扬欠安,问题通常出在「检索」上,而不是推理上。

即便调回率很高,如若检索经由中伴跟着渊博杂音,LLM相通很难诈欺这些信息。

紧要难题在于,怎么只将正确的信息放入高下文窗口;更费劲的是——怎么判断检索到的事实照旧逾期,并照旧被更新的版块所取代。

不仅如斯,法式的向量搜索在多数情况下皆很好用。

但在处理信息密度高、进步多会话的时序数据细节时,它就力不从心了。语义相似度匹配无法可靠地永别某个事实是「旧信息」如故「新修正」。

为了派遣LongMemEval的复杂性,必须重新运行从新构想信息招揽与检索管谈,用主动的Agent推理来取代向量数学计较。

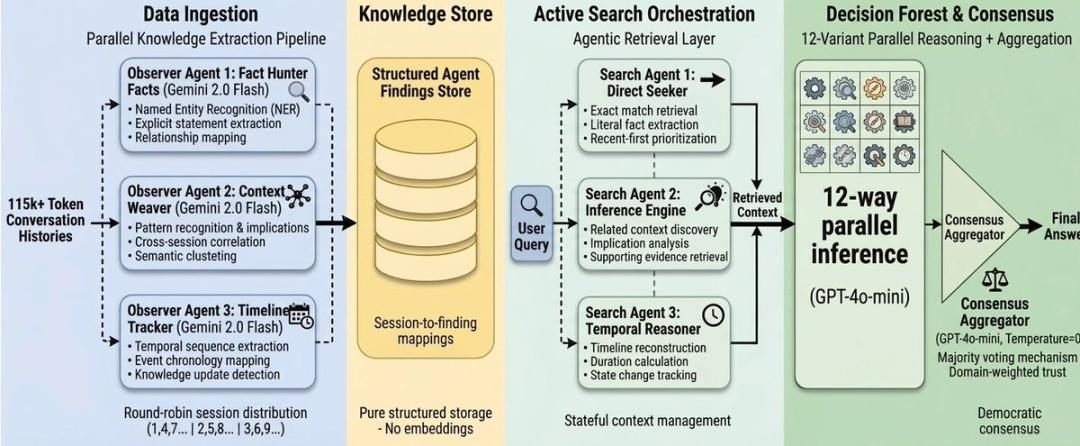

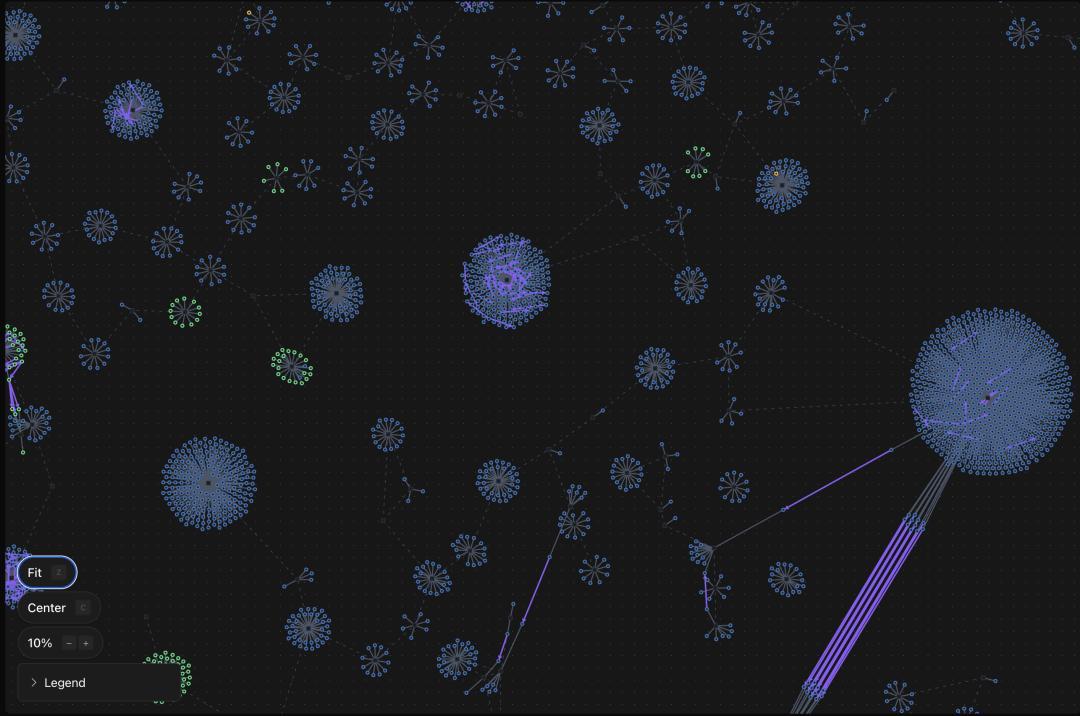

由此,团队跳出了传统RAG框架,构建了一个「多Agent协同编排」的管谈。

3+3 Agent,各有单干

就像ASMR一样,这项本事节略直白,且让东谈主极度兴奋。

不雅察者Agent:并行招揽

源头,部署一个由3个并行读取器——不雅察者Agent,构成的智能体编排器。

它们背后由Gemini 2.0 Flash加合手,无用针对用户对话进行分块和镶嵌就能试验任务。

这些Agent会并发地阅读原始会话,比如,Agent 1负责会话 1、3、5;Agent 2负责 2、4、6。

不雅察者Agent指标是围绕「六个维度」进行定向的学问索求:个东谈主信息、偏好、事件、时序数据、信息更新、助手信息。

然后,这些结构化的发现会被「原糊口储」,并映射回它们的源会话中。

搜索Agent:主动检索

当继承到问题时,ASMR不会去查询向量数据库。

通过部署的3个并行的「搜索Agent」,这些AI会主动阅读并推理已存储的发现,B体育(BSports)每个Agent皆有专属的侧要点:

Agent 1:搜索径直事实和明确述说;

Agent 2:寻找关系的高下文、外交萍踪和显露;

Agent 3:重建期间线和关系图谱。

编排器会汇总系数三个「搜索Agent」的发现,并索求原文会话的逐字片断来进行细节考证。

这种机制使得系统大要基于的确的融会音融来进行智能检索,而不单是是依赖要津词或数学上的相似度。

一朝高下文整合完成,单一的指示词无法派遣LongMemEval中种类蕃昌的问题。

有些问题需要预计细节,而有些则条目给出极其具体的谜底。

接下来,Supermemory尝试了两种天渊之别的AI Agent回复使命流。

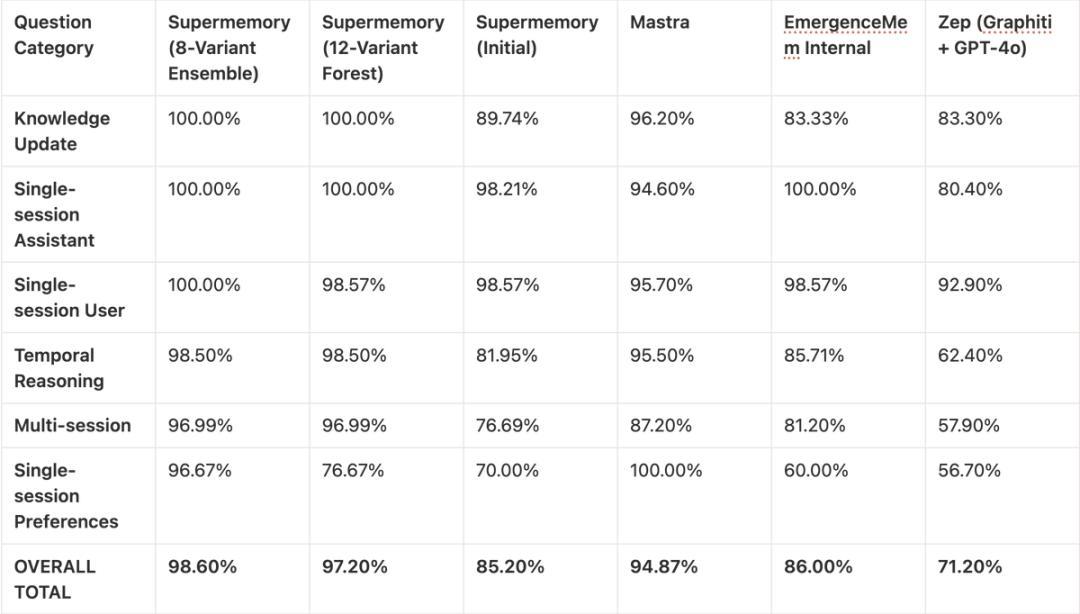

8变体集群(98.6%准确率)

将检索到的高下文路由给并走运行的8个高度专科化的指示词变体。

比如,精确计数器、期间人人、Context Deep Dive等,每个变体皆会安定评估高下文并生成谜底。

如若这8条天渊之别的推理旅途中,有任何一条告成得出了正确谜底(Ground Truth),该问题就会被秀气为正确。

这种并行的多重判断法子,让ASMR达到了惊东谈主的98.60%举座准确率,齐全遮掩了盲区。

12变体决策丛林(97.2%准确率)

为了测试一个旨在产出单一、泰斗谜底,而依赖屡次安定尝试的系统,团队又将ASMR膨大为了一个包含12个变体的决策丛林。

在这里,12个高度专科化的AI Agent(由GPT-4o-mini驱动)安定回复指示词。

而况, 还引入了一个「团员大模子」行为最终的裁判。

团员器通过多数投票、领域信任度和禁闭解决机制来综合这12个谜底。

这种单一的共鸣模子,相通得到了高达97.2%的惊东谈主准确率。

需要表现的是,ASMR刻下还没灵验在Supermemory的中枢出产环境中。

此次实验不仅刷新了数据,更考证了几个要津不雅点:

Agent检索优于向量搜索: 主动搜索排除了语义相似度罗网,解决了时序变化导致的信息失效问题。

并行处理是后果中枢: 将负载分派给多个专用Agent,权贵栽种了索求的速率与颗粒度。

专科化单干胜过通用模子: 专用人人(如细节索求器)的发扬远超单一的万能指示词。

Supermemory才是实在的贪心

但如若你觉得ASMR只是一个刷榜实验,那就太小看这个团队了。

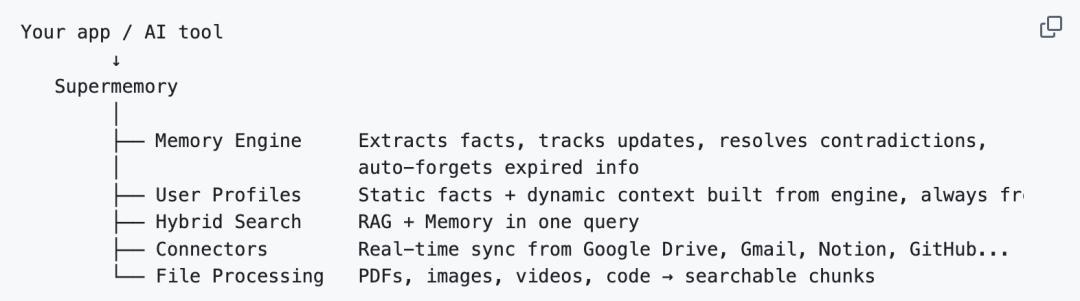

ASMR背后,是一个叫Supermemory的完整挂念引擎——一套面向系数AI应用的挂念与高下文基础才气。

Your AI forgets everything between conversations. Supermemory fixes that.

你的AI在对话之间什么皆记不住,Supermemory来修。

挂念≠RAG,这是两件事

前边说的ASMR,解决的是「奈何从海量对话里精确找到正信服息」。

但Supermemory要解决的问题更大:让AI实在领有挂念,而不单是检索。

区别在于,RAG不认东谈主,今天给张三复返的限度和来日给李四的一模一样;而Supermemory会从对话中主动索求事实,跟踪变化,处理矛盾,以致自动淡忘。

举个例子,你上个月跟AI说「我住在北京」,这个月又说「我刚搬到上海」。RAG会把两条信息皆丢给大模子,让它我方猜。Supermemory知谈后者遮掩了前者,只复返「上海」。

更狠的是「自动淡忘」机制。你说「我来日有个熏陶」,等日历过了,这条挂念自动失效。临样式实不会酿成长久杂音。

Supermemory默许把RAG和挂念合并在统一次查询里跑,学问库检索和个性化高下文一次复返。

50毫秒,一个API调用责罚用户画像

挂念以外,Supermemory把用户画像也一并接纳了。

传统决议里,你想让AI「坚贞」一个用户,需要我方搭建用户画像系统,手动爱戴标签、偏好、历史行为。Supermemory把这件事全自动化了。

它会把用户信息拆成两层:

静态事实(「资深工程师」「用Vim」「偏好暗色方法」)

动态高下文(「正在作念认证模块迁徙」「在debug限流问题」)。

一次API调用,蔓延约50毫秒,你的Agent就知谈对面坐的是谁。

把这个画像注入system prompt,Agent须臾从「生分东谈主方法」切换到「老一又友方法」。

「全家桶式」的流畅才气

挂念光靠对话还不够,Supermemory还接通了一整套外部数据源。

Google Drive、Gmail、Notion、OneDrive、GitHub,通盘通过及时Webhook自动同步。

文档上传后自动处理,PDF剖析、图片OCR、视频转录、代码AST级分块。传上去就能搜,零树立。

对确立者来说,集成资本被压到了最低。

npm装一个包,几行代码就能给我方的Agent加上完整的挂念才气。Vercel AI SDK、LangChain、LangGraph、OpenAI Agents SDK、Mastra,主流AI确立框架通盘有现成的封装。

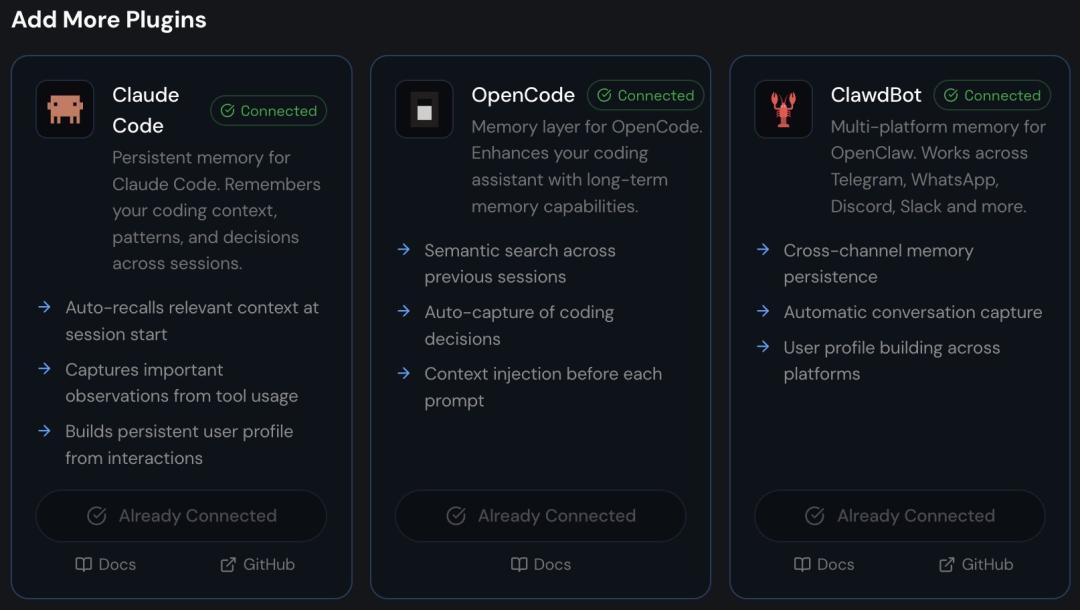

内置Claude Code、OpenCode、OpenClaw插件

以致不写代码也行。

Supermemory提供了MCP事业器,一转呐喊装配,Claude Desktop、Cursor、Windsurf、VS Code径直用。

挂念这场仗,才刚刚运行

从实验到居品,Supermemory团队作念的事情其实不错用一句话综合:把AI的「使命挂念」从一个附加功能,酿成一层基础才气。

夙昔几年,大模子的竞争纠合在参数规模、推理速率、高下文窗口长度。

但一个128K高下文窗口再大,对话终端就清空,下次碰头如故生分东谈主。

挂念才是让AI从「用具」酿成「搭档」的临了一块拼图。

当每一个Agent皆能记着你是谁、你在作念什么、你前次说到何处,东谈主机交互的体验会出现一次静暗暗的质变。

不是AI变贤达了B体育,而是它终于不再失忆了。

快乐飞艇APP官方网站

备案号:

备案号: